En clinique, le point de friction n’est presque jamais la curiosité pour l’IA ; c’est la gouvernance. Un supervisé souhaite de l’aide pour réécrire un rapport scolaire sensible, résumer une évaluation en ergothérapie ou rédiger un formulaire de consentement en arabe simplifié, puis pose la question que nous connaissons tous : « Puis-je coller le texte réel ? » L’inconfort éthique tient au fait que la plupart des systèmes conversationnels sont, par conception, médiés par le cloud, et notre réponse devient alors un cours de gestion des risques plutôt qu’un appui cliniquement utile.

C’est pourquoi l’affirmation « Imaginez ChatGPT, mais installé directement sur votre appareil… privé, hors ligne et gratuit » se diffuse si rapidement. Elle évoque la réconciliation promise entre capacité et confidentialité. Mais les slogans ne sont pas des garde-fous, et « l’énergie de PDG » ne constitue pas un cadre de gouvernance clinique. Même lorsqu’un outil provient d’une grande entreprise, la marque ne remplace pas l’évaluation des flux de travail, de l’auditabilité et des modes de défaillance.

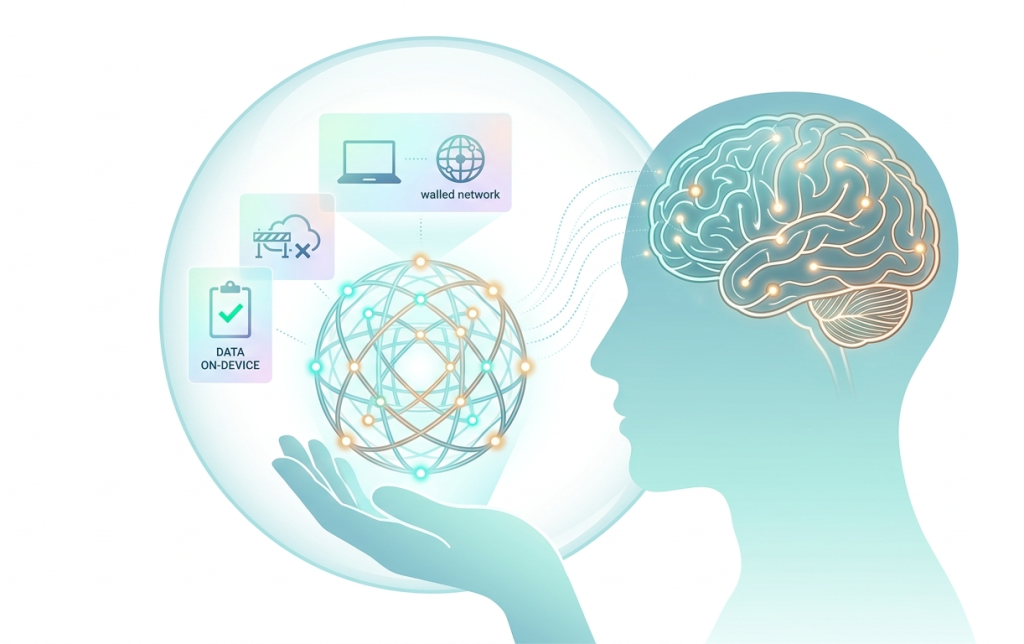

Ce que cela traduit plus précisément, c’est l’essor d’un écosystème de modèles « local capable », dont Gemma 4, téléchargeables et exécutables dans des environnements contrôlés. La promesse est simple : poser des questions, générer du texte, structurer la documentation et, dans certaines configurations, traiter aussi des tâches liées à l’image, avec un calcul effectué sur votre propre appareil. Ce détail — l’endroit où s’exécute le modèle — n’est pas anecdotique : il est au cœur de la confidentialité.

La question du « prix » est déterminante pour les thérapeutes, car elle modifie les dynamiques d’adoption. Si un modèle est « gratuit » à télécharger et à exécuter, la contrainte se déplace vers les exigences matérielles et le temps de configuration. Vous « payez » autrement : batterie, chauffe, stockage, maintenance et dépannage. Mais le changement psychologique est majeur : la technologie devient suffisamment accessible pour s’intégrer dans des pratiques réelles, et non plus seulement comme un outil expérimental.

La comparaison est donc pertinente, car elle touche au cœur du flux de travail : vous choisissez une IA, mais aussi un circuit de données. Gemma 4 est une option locale, mais pas la seule. De nombreux utilisateurs exécutent également des modèles de type DeepSeek, tandis que d’autres optent pour Llama, Mistral ou Qwen selon leur matériel et leurs contraintes de licence. En résumé : les modèles locaux peuvent soutenir une confidentialité plus stricte en gardant les données en interne, tandis que les modèles cloud (ChatGPT, Claude, Gemini) offrent davantage de commodité et d’évolutivité, mais exigent des règles plus rigoureuses.

La formule « Google ne voit rien » n’est donc vraie que sous une condition précise : une exécution réellement locale. Le « local » n’est pas une perception, mais une implémentation : exécution hors ligne, absence de téléversements, paramètres vérifiables. Toute utilisation via navigateur ou application web doit être considérée comme du cloud.

Cliniquement, l’intérêt majeur de l’IA locale n’est pas la nouveauté, mais l’élargissement des tâches réalisables sans exposition de données sensibles : rédaction de courriers, psychoéducation, adaptation de supports, création de canevas de séance. Cela réduit la charge administrative tout en respectant davantage l’esprit de la confidentialité.

Cependant, une question essentielle demeure : cela améliore-t-il réellement le raisonnement clinique ? Le risque est qu’une production fluide donne l’illusion d’une validité clinique. L’IA doit rester un outil de structuration et non un substitut au jugement clinique.

L’idée de « sans limites » doit également être nuancée. Les modèles locaux ne sont pas limités par un abonnement, mais restent contraints par le matériel. Et surtout, « hors ligne » ne signifie pas « fiable » : biais et hallucinations persistent.

Sur le plan éthique, l’IA locale concentre la responsabilité. Utiliser des données identifiables implique de maîtriser la sécurité de l’appareil, la journalisation, la provenance du modèle et la traçabilité de l’usage. La transparence devient une pratique : documenter quand et comment l’IA est utilisée.

Ce qui est cliniquement intéressant, ce n’est pas l’illusion d’une « IA privée parfaite », mais la possibilité de concevoir des usages hybrides et nuancés : modèles locaux pour les contenus sensibles, systèmes cloud pour les tâches documentaires sous gouvernance.